Daseinsberechtigung von spezialisierter Software im KI Zeitalter (2026)

Was passiert, wenn die großen KI Modellanbieter sich immer weiter in spezifische Anwendungen einarbeiten? Wie sehr braucht es dann überhaupt noch spezialisierte KI?

Leonard Wossnig

Co-Founder and CTO

OpenAI Frontier hat das Ziel zum KI Teammitglied für Unternehmen zu werden. Es ist OpenAIs Reaktion auf Claude Co-Work, das kürzlich in den Medien als echtes Automatisierungstool für Geschäftsanwender gefeiert wurde.

Ich habe vor kurzem mit einem Freund gesprochen, Bowen, einem Gründer, der zuvor Investor bei der US Risikokapitalgesellschaft a16z war. Er fragte mich, welche Schutzgräben unser Unternehmen hat. Am Tag darauf stellte Christie, eine andere Gründerin, die ich zum Kaffee traf, dieselbe Frage in anderem Gewand: „Wie denkst du über Verteidigungsfähigkeit bzw die Daseinsberechtigung von fachspezifischer KI nach?"

Diese Gespräche stehen nicht für sich allein. Das Thema taucht in der Startup und VC Welt immer wieder auf, weil wir rasante Fortschritte bei KI Coding Agents und allgemeine Leistungssteigerungen der großen Modellanbieter beobachten. Von einfachen Programmieraufgaben bis hin zu hochkomplexer Wissensarbeit haben wir gesehen, wie die Foundation Model Anbieter sich schrittweise der Anwendungsschicht nähern, zunächst durch Coding Tools und zuletzt durch Wissensarbeit in Bereichen wie Finanzen, Recht und Buchhaltung mit Produkten wie Claude Cowork. OpenAIs Veröffentlichung von Frontier heute ist der jüngste Schritt in dieselbe Richtung, und die Frage der Verteidigungsfähigkeit fühlt sich dadurch drängender an als je zuvor.

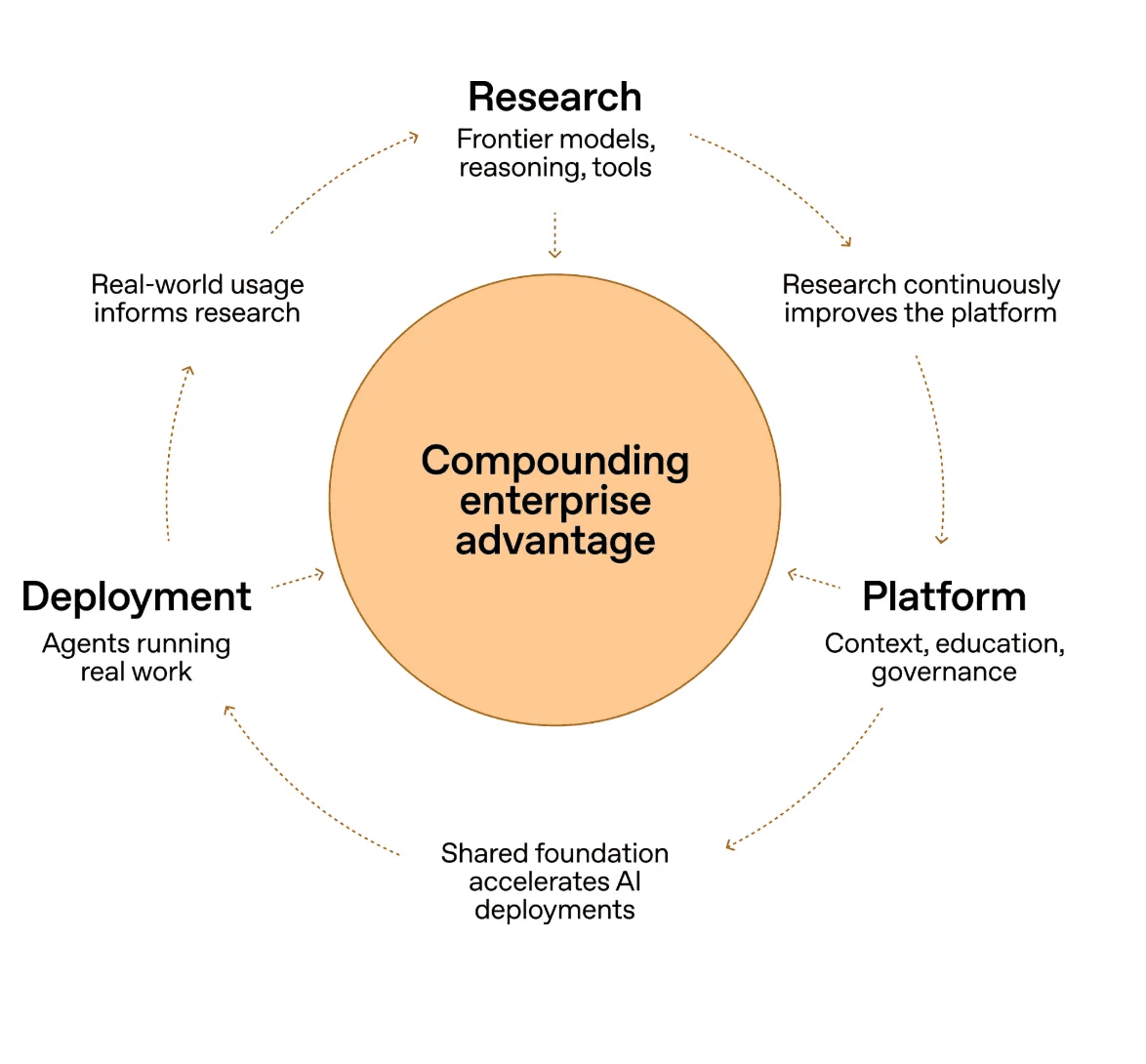

OpenAI Frontier positioniert sich als vollständige Plattform für die Bedürfnisse von Unternehmen.

Die Zahlen machen den Einsatz greifbar. Anthropics Veröffentlichung des Claude Cowork Legal Plugins am 2. Februar 2026 vernichtete in einer einzigen Handelssitzung rund 285 Milliarden Dollar an Börsenwert bei Software und Rechtstechnologieunternehmen, wobei Thomson Reuters um 16 %, RELX um 14 % und Wolters Kluwer um 13 % fielen. Kurz darauf sammelte Anthropic 30 Milliarden Dollar bei einer Bewertung von 380 Milliarden Dollar ein, was deutlich macht, dass das Unternehmen über das Kapital verfügt, um den Eintritt in vertikale Märkte in großem Maßstab zu verfolgen. Vor diesem Hintergrund ist die Frage der Verteidigungsfähigkeit nicht mehr akademisch. Sie ist besonders kritisch für KI Anwendungs-Startups, die auf Foundation Model Fähigkeiten aufbauen, wo sowohl der rasante Wandel der zugrunde liegenden Technologie als auch das schnelle Voranschreiten der Konkurrenz durch die Modellanbieter selbst bedeuten, dass Startups schneller sein müssen als je zuvor.

Im Folgenden möchte ich darlegen, wie ich über Schutzgräben für B2B KI Anwendungen im Jahr 2026 denke: was aufgefressen wird, was nicht, und was wir als Gründer dagegen tun können. Anmerkung: Auch wenn KI einiges verändert, bleiben viele der alten Grundlagen weiterhin gültig.

Was die Foundation Model Schicht auffrisst

Die Modellanbieter übernehmen zunehmend mehr von der Anwendungsschicht. Das steht nicht mehr zur Debatte. Sie haben bereits einen großen Teil der Softwareentwicklung absorbiert und zuletzt auch das untere Ende der juristischen Arbeit, des Prüfungswesens und anderer Wissensarbeit.

Das fällt ihnen leicht, weil es viel niedrig hängendes Obst gibt: Wissensarbeit, die verbreitet, wiederholbar und von begrenzter Komplexität ist. Das Schreiben eines Standard NDAs fällt genau in diese Kategorie. Fallrecht hingegen, bei dem Inhalte über Jahrzehnte gesammelt, kuratiert und redaktionell validiert wurden, nicht.

Drei weitere Dynamiken beschleunigen dies. Die erste sind Skills. Anthropic hat sein Produkt so gestaltet, dass es in natürlicher Sprache leicht erweiterbar ist, und Skills ermöglichen es jedem Nutzer, einen Prozess durch einfache, wiederholbare Anweisungen zu definieren und zu verfeinern, die in einer Organisation geteilt werden können. Wo der Einsatz nicht zu hoch ist, kann eine verantwortliche Person einen Skill schreiben und mit dem Team teilen, und das Allzwecktool wird ohne jegliche Integrationsarbeit an die Organisation angepasst. Es ist nicht viel komplexer als die Einarbeitung eines Juniorangestellten, und dank der iterativen Feedbackschleife in der Chat Oberfläche kann jeder es verfeinern, bis es wie gewünscht funktioniert. In gewisser Weise ist das Reinforcement Learning in der realen Welt.

Was Skills bedeutsam macht, ist das, was sie verdrängen. Früher erforderte diese Art der Anpassung vorort eingesetzte Ingenieure oder Budgets für professionelle Dienstleistungen, und genau so wird die meiste Legacy Enterprise Software heute noch angepasst. Jetzt kann das jeder in der Organisation tun. Dieser Wandel ist wohl einer der größten Unterschiede zwischen KI nativen Plattformen und dem Legacy Softwarestack, den sie zu ersetzen beginnen.

Die zweite Dynamik ist die Kombination aus Agents und Konnektoren. Agents können direkt über unstrukturierte Daten schlussfolgern, was eine Klasse von Arbeit eliminiert, die vertikale SaaS Unternehmen historisch im Auftrag des Kunden erledigen mussten: Datenmodellierung, Bereinigung, Schemadesign, ETL und die allgemeine Infrastrukturarbeit, um Informationen in eine nutzbare Form zu bringen. Gleichzeitig liefern die Modellanbieter bereits native Konnektoren zu den Orten, an denen Unternehmensdaten tatsächlich liegen. Claude Cowork verbindet sich standardmäßig mit Google Drive, Gmail und DocuSign, und ähnliche Konnektoren existieren für SharePoint und den Rest des Microsoft 365 Stacks. Die Kombination bedeutet, dass ein Allzweck Agent auf dem bestehenden Dokumentenbestand eines Kunden aufsitzen und nützliche Arbeit leisten kann, ohne dass der Kunde Daten exportieren, in ein neues Schema überführen oder eine dedizierte Integration aufsetzen muss. Der implizite Schutzgraben durch Datenzugang, auf den sich viele vertikale Tools stillschweigend verlassen haben, sieht in diesem Licht dünner aus.

Die dritte Dynamik ist der Vorstoß in die Unternehmensdistribution. Im März 2026 stellte Anthropic 100 Millionen Dollar für ein Claude Partner Network bereit, das Accenture, Deloitte, Cognizant und Infosys in sein Enterprise Ökosystem einband. Das ist ein neuer und zu wenig diskutierter Angriffsvektor. Für jedes KI Anwendungs-Startup, das an Beratungsunternehmen, globale Systemintegratoren oder Großunternehmen verkauft, kann der Foundation Model Anbieter nun die eigenen Kunden über dieselben Partner erreichen, die zuvor das eigene Produkt verkauft haben. Es ist ein Distributionskanal, der direkt in die größten Käufer vertikaler KI Software führt, und zusammen mit Skills und dem Stack aus Agents und Konnektoren komprimiert er drei bisher getrennte Vorteile auf der Anwendungsschicht: Anpassung, Datenzugang und Distribution.

Natürlich gibt es eine Grenze für das, was absorbiert werden kann. Die Komplexität von Workflows ist derzeit eine Grenze. Viele menschliche Wissensarbeitsabläufe lassen sich noch nicht in einen einfachen Skill übersetzen, teils aufgrund von Modellbeschränkungen, teils aufgrund der Art, wie Modelle von Unternehmen und Nutzern integriert und verwendet werden, und teils aufgrund der Informationen und Handlungen, auf die die Modelle zugreifen können. Ich erwarte, dass sich diese Grenze im Laufe der Zeit verschieben wird, insbesondere für verifizierbare Arbeit (bei der Erfolg an einem klaren Ergebnis gemessen werden kann), und die Generierung von Skills wird für solche Aufgaben wahrscheinlich stärker automatisiert werden. Bei nicht verifizierbarer Arbeit werden Agents und Skills die Aufgabe weniger wahrscheinlich vollständig automatisieren, und das stellt vielleicht einen kleinen Schutzgraben dar.

Was die Foundation Model Schicht nicht auffrisst

Ein aktueller Fortune Artikel diskutierte die Fortschritte der Modellanbieter im Kontext von Legal AI. Es ist vorab erwähnenswert, dass der Artikel von einer Führungskraft von Thomson Reuters verfasst wurde, sodass die Rahmung tendenziell eigennützig ist, aber das zugrunde liegende Argument ist dennoch nützlich. Der Artikel argumentiert, dass Claude Cowork, Harvey, Legora und Libra eigentlich in derselben Kategorie von Legal AI operieren: der „nicht autoritativen Schicht", die Aufgaben wie die Standardisierung von Formatierungen, die Überprüfung interner Dokumente und das Management operativer Workflows umfasst (was der Artikel als operative Rechtsaufgaben bezeichnet). Foundation Models bewältigen diese Schicht gut.

Wo die Legal AI Unternehmen immer noch einen Vorsprung haben, ist durch proprietäre Dateninfrastruktur (Westlaw, LexisNexis, Wolters Kluwer), die über Jahrzehnte kuratiert, validiert und redaktionell gepflegt wurde. Foundation Models ersetzen diese Infrastruktur nicht. Ein ergänzender Blickwinkel aus dem HAQQ Blog macht einen ähnlichen Punkt von außerhalb des Incumbent Lagers: Claudes Plugin hat Legal Tech nicht getötet, es hat offengelegt, welche Schichten des Stacks keine Verteidigung hatten.

Das bringt uns zum ersten Schutzgraben, der weiterhin Bestand haben wird: Anwendungen, die auf wirklich einzigartigen oder schwer zu beschaffenden Daten aufgebaut sind, werden verteidigungsfähig bleiben, mit einem Vorbehalt, auf den ich weiter unten zurückkomme.

Ein Teil einzigartiger Daten ist auch das, was oft als Daten Schwungräder bezeichnet wird. Ich würde das ausdrücklich von Netzwerkeffekten unterscheiden (die weiter unten besprochen werden), obwohl beides oft vermischt wird. Die Daten, die Nutzer auf einer Plattform generieren (vergangene Angebote, gewonnene Ausschreibungen, Qualifizierungssignale, Feedback zur Ausschreibungspassung oder auch Nutzerpräferenzen und Regeln), führen kumulativ zu besseren Ergebnissen für dieselben Nutzer auf der Plattform, was einen Wechselkosten erzeugt, der in Ergebnissen statt in Gewohnheit verwurzelt ist. Das ist ein Daten Schutzgraben, und für vertikale KI Anwendungen ist er heute einer der dauerhafteren, solange die Daten dem Unternehmen gehören (nicht dem Nutzer) und direkt das Ergebnis für den Nutzer verbessern.

Ein Vorbehalt zur These der proprietären Daten: Der Daten Schutzgraben wird schwächer, nicht stärker. Das ist keine neue Beobachtung. a16z argumentierte 2024, dass Daten allein selten ein starker genug Schutzgraben für Enterprise Startups sind, und Sequoia machte einen ähnlichen Punkt, als sie schrieben, dass Daten Schutzgräben auf wackeligem Boden stehen und Workflows und Nutzernetzwerke die dauerhafteren Quellen von Wettbewerbsvorteilen sind.

Drei Kräfte erodieren den Vorteil kuratierter Korpora schneller, als die meisten wahrhaben wollen: synthetische Daten, Reinforcement Learning mit verifizierbaren Belohnungen und direkte Lizenzierungsvereinbarungen. Manche proprietären Datensätze werden sich als bei ausreichender Skalierung rekonstruierbar herausstellen, und Modellanbieter sind zunehmend bereit, zu lizenzieren, was ihnen fehlt. Was heute wie ein Schutzgraben aussieht, könnte sich in drei Jahren als bloßer Zeitvorsprung herausstellen.

Die Schlussfolgerung ist einfach: Daten allein reichen nicht aus.

Über Daten hinaus sehe ich drei weitere Schutzgräben, die häufig diskutiert werden und in der Welt der KI möglicherweise Bestand haben:

Referenzverkäufe. Als Erster in einen Markt einzutreten und glaubwürdige Logos zu gewinnen, erzeugt einen Vertrauensgradienten, den Wettbewerber erst erklimmen müssen. Im B2B Bereich folgen neue Käufer überproportional dem, was ihre Peers getan haben, und Referenzkunden verkürzen Verkaufszyklen. Das ist real, aber es ist eher eine Verzögerung als ein dauerhafter Schutzgraben. In dem Moment, in dem ein gut finanzierter Wettbewerber ein größeres Logo im selben Segment gewinnt, komprimiert sich der Referenzvorteil. Geschwindigkeit zum Markt zählt, und Erster zu sein verstärkt diesen Schutzgraben.

Ein Freund von mir, Joachim, ein Engineering Manager bei Legora, hat mir das neulich beim Kaffee geschärft. Seine Beobachtung war, dass die Nutzer, die man durch Referenzverkäufe gewinnt, selten neutral bleiben. Sie bauen Workflows auf dem eigenen Produkt auf, und diese Verankerung schneidet in beide Richtungen: Wettbewerber finden es schwerer, einen herauszulösen, aber man selbst findet es auch schwerer, ihnen davonzulaufen, weil die eigenen Nutzer an das gebunden sind, was man bereits ausgeliefert hat. Das ist besonders ausgeprägt, wenn die Kunden große, langsame Legacy Organisationen sind, deren Prozesse um die bestehende Lösung herum gebaut sind. Erster zu sein wird zum zweischneidigen Schwert, und je klebriger die Referenzkunden sind, desto schärfer die Klinge.

Diese Klebrigkeit ist der Punkt, an dem Referenzverkäufe beginnen, in den nächsten Schutzgraben überzugehen.

Netzwerkeffekte. Diese sind die klebrigeren, und langfristig halte ich sie für die dauerhaftesten unter den Nicht Daten Schutzgräben. In der öffentlichen Beschaffung im Speziellen sind die interessanten Netzwerkeffekte die Subunternehmer Netzwerke und Bieterkonsortien, die sich um erfolgreiche Teams bilden. Sobald ein Generalunternehmer, ein spezialisierter Subunternehmer und ein Konsortialpartner auf einer Plattform zusammengearbeitet haben, sind die Kosten, diese gesamte Gruppe zu einem Wettbewerber zu bewegen, deutlich höher als die Kosten, ein einzelnes Unternehmen zu bewegen. Das sind echte zweiseitige Effekte, und sie brauchen Jahre, um aufgebaut zu werden. Generell bleibt es schwierig, ganze Unternehmen auf eine andere Plattform zu migrieren (selbst eine, die günstiger oder geringfügig besser ist). Ich erwarte, dass das noch eine Weile gelten wird, zumindest solange Menschen und nicht Agents die Kaufentscheidungen treffen.

Ein weiterer Schutzgraben, der möglicherweise Bestand hat, ist Geschmack und gutes Produkturteil. Das ist der letzte, den ich explizit hervorheben möchte, und er knüpft an das an, was ich in meinem vorherigen Artikel über KI Agents in der Softwareentwicklung geschrieben habe. Wenn die Umsetzung billiger wird, verschiebt sich der Engpass hin zu Produktentdeckung und Urteilsvermögen: zu wissen, was man bauen soll, für wen, und in welcher Reihenfolge. Harveys Gabe Pereyra hat argumentiert, dass derselbe Wandel sich nun im Rechtsbereich vollzieht, wo der Durchsatz bei der Ausführung nicht mehr der begrenzende Faktor ist und Organisationen sich stattdessen um Überprüfung, Koordination und Urteilsvermögen reorganisieren müssen. Das ist schwer zu automatisieren, weil es von der Nähe zum Problem abhängt, von der Iteration mit echten Nutzern und von der Ansammlung von Meinungen darüber, was in einer bestimmten Domäne gut aussieht. Ich glaube, das ist der am meisten unterschätzte Schutzgraben für Unternehmen auf der Anwendungsschicht im Jahr 2026, gerade weil er nicht durch einen Skill, ein Plugin oder ein besseres Modell repliziert werden kann. Die Unternehmen, die Geschmack kumulieren, werden diejenigen überflügeln, die Features kumulieren.

Es gibt einen offensichtlichen Einwand. Herauszufinden, was man bauen soll, ist jetzt die wichtigste und teuerste Arbeit, aber sobald man es herausgefunden hat, kann ein Wettbewerber die Antwort einfach kopieren. Das trifft auf jede einzelne Entscheidung zu. Wenn man ein Feature ausliefert, das einschlägt, wird ein schneller Nachahmer es innerhalb von Monaten replizieren, ohne die Entdeckungskosten zu zahlen, die man selbst dafür aufgebracht hat. Was sie nicht so leicht kopieren können, ist die fortlaufende Fähigkeit, die nächste Entscheidung gut zu treffen, und die steckt im institutionellen Wissen eines Teams, das dem Problem seit Jahren nah ist. Nachahmer kopieren Antworten. Das Urteilsvermögen, das die Antworten hervorbringt, ist das, was sich kumuliert.

Alles andere, Geschwindigkeit, Integrationstiefe und Funktionsparität, ist bestenfalls ein kurzfristiger Vorteil. Agentische Coding Workflows lassen die Kosten für den Aufbau von Integrationen und das Aufholen bei Features zusammenschrumpfen, und ein Zweijahresvorsprung gemessen an ausgelieferter Funktionalität ist nicht mehr das, was er 2022 war. Jeder Schutzgraben, der darauf beruht, „wir haben mehr von X als sie", sollte als komprimierbar angenommen werden. Was sich kumuliert, ist die Kombination aus proprietären Daten mit Workflows, Beziehungen, Netzwerkeffekten und Geschmack.

Die schwierigere Frage

Es gibt eine schärfere Version der Verteidigungsfähigkeitsfrage, der diese Art von Analyse meiner Meinung nach gerne ausweicht, und es lohnt sich, sie direkt anzugehen. Die eigentliche Bedrohung ist wahrscheinlich nicht der Foundation Model Anbieter. Sie sind groß, gut kapitalisiert, und ihre Schritte sind im Voraus sichtbar. Das Partner Network, Skills und die Cowork Vertikalen sind allesamt vorhersehbare Bedrohungen, und vorhersehbare Bedrohungen sind die einfachere Art, um die man planen kann.

Die schwierigere Bedrohung ist das nächste Startup auf der Anwendungsschicht, das zwei Jahre nach deinem gegründet wird, auf günstigerer Inferenz, besserem Tooling und einem fünfköpfigen agentischen Engineering Team aufbaut, das so schnell liefert wie dein Team aus achtzehn. Die Barrieren für den Aufbau einer gut integrierten vertikalen Anwendung sinken für alle, und das schließt den Wettbewerber ein, der noch nicht existiert. In diesem Rahmen sind „wir sind zwei Jahre bei den Features voraus" oder „wir haben die tiefsten Integrationen" keine Schutzgräben, sondern genau die Vorteile, die der nächste Marktteilnehmer schneller replizieren wird als der letzte es konnte.

Das schärft das frühere Argument, anstatt ihm zu widersprechen. Genau deshalb sind proprietäre Daten, die sich kumulieren, Netzwerkeffekte, die Jahre brauchen, um aufgebaut zu werden, und Geschmack, der angesammelt statt kopiert wird, die Kategorien, auf die man sich konzentrieren sollte. Das sind die Schutzgräben, um die ein Neuling nicht mit besseren Modellfähigkeiten, günstigerer Inferenz oder sogar dem Kopieren des Produkts herumkommt. Features, Geschwindigkeit und Integrationsanzahl sind alles Vorteile, die sie replizieren können.

Was Gründer tun sollten

Die Frage von Kaufen versus Selbstbauen wird wieder auftauchen, wenn die KI Adoption einfacher wird. „Schreib einfach einen Skill und teile ihn mit dem Team" ist eine starke Proposition, aber das Schreiben und Pflegen von Skills kostet Zeit, und eine ordentliche Evaluierung ist immer noch schwierig (man braucht die Infrastruktur, die Daten und die Möglichkeit, richtige Tests durchzuführen). Wartungskosten für geteilte Skills in großen Organisationen werden sich zusätzlich kumulieren. Für viele Unternehmen wird es sich nicht lohnen, das intern zu machen, weil das Schreiben von Skills nicht ihr Kerngeschäft ist. Also wird ein Marktplatz für Skills entstehen, zusammen mit spezialisierter Software, die diese Skills und Workflows entweder direkt anbietet oder in tiefere vertikale Produkte einbettet.

Das wird besonders für Nischenmärkte gelten, einschließlich lokaler europäischer Rechtsarbeit, öffentlicher Beschaffung und anderer Vertikalen, bei denen die Modellanbieter sich zunächst auf den US Markt und die Anwendungsfälle mit dem höchsten Volumen konzentrieren werden. Nicht alles wird sofort von den großen Anbietern aufgefressen.

Wenn du 2026 ein KI Anwendungsunternehmen aufbaust, konzentriere dich darauf, ein großartiges Produkt zu bauen, und halte dich an die alten Grundlagen: eine dauerhafte Kombination aus proprietären Daten, Netzwerk oder Schwungradeffekten und einem Team mit echtem Gespür für das Problem. Alles andere komprimiert sich.

Webinars

Vergaberecht Advanced: So etablieren sich Unternehmen erfolgreich am öffentlichen Beschaffungsmarkt

Das Webinar richtet sich an Geschäftsführer*innen und Vertriebsverantwortliche, die öffentliche Aufträge als Vertriebskanal etablieren wollen.

Felicitas von Rauch

Insights

Daseinsberechtigung von spezialisierter Software im KI Zeitalter (2026)

Was passiert, wenn die großen KI Modellanbieter sich immer weiter in spezifische Anwendungen einarbeiten? Wie sehr braucht es dann überhaupt noch spezialisierte KI?

Leonard Wossnig

Customer stories

Wie Arsipa seine Erfolgsquote um 78 % gesteigert hat

Arsipa nutzt Forgent AI, um die Bearbeitung von Ausschreibungen in der wachsenden Unternehmensgruppe zu zentralisieren und zu skalieren, und erreicht dabei 83 % weniger Aufwand bei Angebotsentscheidungen sowie eine um 78 % höhere Erfolgsquote.

Felicitas von Rauch